La inteligencia artificial (IA) está transformando la forma en que operan las organizaciones: desde la automatización de procesos empresariales hasta la mejora de la experiencia del cliente. A medida que la adopción de IA se acelera, también aumentan las preocupaciones sobre la privacidad de los datos, la integridad de los modelos y el cumplimiento normativo.

En Olive + Goose, creemos que la innovación nunca debe comprometer la confianza. Por eso, el despliegue seguro y responsable de la IA es cada vez más importante. Las organizaciones deben pasar de una seguridad reactiva a una gobernanza proactiva, integrando protecciones en cada capa del ciclo de vida de la IA.

Este blog presenta un marco práctico para desplegar IA de forma segura en entornos de Microsoft 365 y Azure, equilibrando innovación con gobernanza y ayudando a las organizaciones a reducir riesgos mientras construyen confianza.

Por Qué Importa el Despliegue Seguro de IA

Los sistemas de IA son tan seguros como los datos, la infraestructura y las políticas que los respaldan. Sin los controles adecuados, la IA puede:

- Exponer datos sensibles

- Amplificar sesgos o desinformación

- Ser explotada mediante ataques adversarios

- Violar obligaciones de cumplimiento (por ejemplo, GDPR, HIPAA)

Además, la confianza pública en la IA está cada vez más ligada a la transparencia y seguridad con la que se desarrolla y despliega. Las organizaciones que no consideran los riesgos éticos y legales pueden enfrentar daños reputacionales, multas regulatorias o ambos.

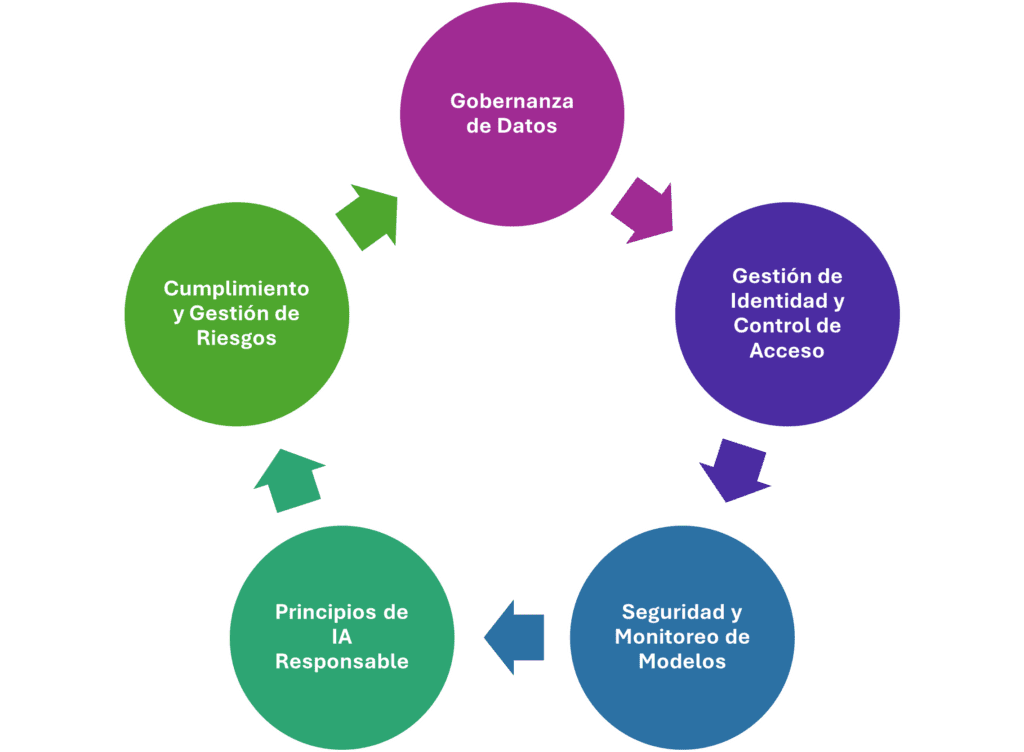

Marco de Despliegue Seguro de IA

Para escalar la IA de forma responsable, se necesita más que modelos y datos: se requiere una base segura y estructurada. En Olive + Goose, alineamos los despliegues de IA con las tecnologías confiables de la nube de Microsoft y los estándares de IA responsable. Estos son los cinco pilares clave que definen un marco ético y seguro:

1. Gobernanza de Datos

La IA comienza con los datos—y proteger esos datos es fundamental.

Utiliza herramientas como Microsoft Purview para:

- Clasificar datos sensibles (por ejemplo, PII, financieros, registros médicos)

- Aplicar cifrado y controles de acceso granulares

- Monitorear el linaje y uso de datos en los sistemas

Además, asegúrate de que los datos de entrenamiento sean:

- Representativos e inclusivos

- Anonimizados cuando sea necesario

- Auditados regularmente para detectar sesgos y calidad

Una gobernanza sólida garantiza que los modelos de IA sean de alto rendimiento, cumplan con las normativas y estén éticamente fundamentados.

2. Control de Acceso y Gestión de Identidad

Restringe el acceso a activos sensibles utilizando las soluciones de identidad integradas de Microsoft:

- Control de Acceso Basado en Roles (RBAC) para gestionar permisos

- Acceso Condicional para políticas en tiempo real

- Microsoft Entra ID (antes Azure AD) para federación de identidad y SSO

Todo acceso debe ser registrado y auditado para garantizar responsabilidad y apoyar la respuesta ante incidentes.

En un entorno de Confianza Cero, la identidad se convierte en el nuevo perímetro. Una gestión adecuada del acceso previene amenazas internas y limita el alcance de posibles brechas.

3. Seguridad y Monitoreo de Modelos

Los modelos de IA deben protegerse contra manipulaciones, robos y usos indebidos.

Utiliza Azure Machine Learning para:

- Gestionar ciclos de vida de modelos

- Rastrear rendimiento, deriva y sesgos con el tiempo

- Aplicar control de versiones y políticas de reversión

Para protección avanzada contra amenazas, Microsoft Defender for Cloud puede detectar anomalías en tus cargas de trabajo de IA y alertarte sobre actividades sospechosas.

La seguridad debe ir más allá del código e incluir riesgos específicos de IA—como inyecciones de instrucciones, entradas adversarias y envenenamiento de datos. El monitoreo y reentrenamiento deben ser continuos.

4. Principios de IA Responsable

Más allá de la seguridad, las organizaciones deben considerar las implicaciones éticas de la IA.

Una sugerencia es adoptar los principios de IA Responsable de Microsoft, que enfatizan:

- Equidad – Prevenir resultados discriminatorios

- Transparencia – Explicar cómo se toman las decisiones

- Responsabilidad – Asignar propiedad de los sistemas de IA

- Privacidad – Respetar los datos y el consentimiento del usuario

Utiliza herramientas como InterpretMLy Fairlearnpara aplicar estos valores en tus flujos de trabajo de IA.

5. Cumplimiento y Gestión de Riesgos

Los sistemas de IA deben alinearse con un panorama creciente de estándares de cumplimiento, incluyendo:

- GDPR, HIPAA, CCPA

- ISO/IEC 27001

- Marco de Gestión de Riesgos de IA de NIST

- Regulaciones específicas de la industria (por ejemplo, servicios financieros, sector público, salud)

Puedes aprovechar Microsoft Compliance Manager para evaluar y mantener tu postura de cumplimiento en entornos de nube.

Además, el cumplimiento proactivo es clave para un despliegue sostenible de IA. Un modelo de gobernanza bien estructurado no solo mitiga riesgos regulatorios—también permite escalar la innovación eliminando obstáculos.

Reflexión Final: Cómo Ayuda Olive + Goose

La IA puede ser un multiplicador de fuerza, pero solo cuando se despliega de forma segura y responsable.

En Olive + Goose, colaboramos con organizaciones para innovar con confianza. Nuestros servicios están diseñados para integrar la confianza en el corazón de tu viaje con IA:

- Evaluaciones de preparación para IA con enfoque en seguridad y cumplimiento

- Implementación de Microsoft Purview para clasificación y gobernanza de datos

- Entra ID y Acceso Condicional para gestión segura de identidad y acceso

- Diseño de estrategias y políticas de IA Responsable

- Soporte de despliegue para Microsoft 365 Copilot y soluciones de Azure OpenAI

No solo ayudamos a desplegar IA—ayudamos a las organizaciones a operacionalizar la gobernanza, seguridad y confianza en IA dentro de su ecosistema Microsoft.

Aviso: Asistencia con IA, aprobado por Olive + Goose.

Referencias: